AI時代の組織に必要な3つの原則|ツールが賢くなるほど設計思想が問われる

AIを業務に組み込む経験を重ねるうちに、気づいたことがあります。

ツールの性能が上がるほど、組織の設計思想が問われる。

これは少し逆説的な話です。普通に考えると、AIが賢くなればなるほど、人間の設計は要らなくなるはずだから。でも実際は逆で、賢いAIを扱う組織ほど、「何を任せ、何を任せないか」「どこに線を引くか」という判断の基準が厳しく問われます。線引きが曖昧な組織では、賢いAIほど暴走のリスクが高くなる。

この記事では、47体のAIエージェント運用と、その先で作ったAI専門組織の構築を通じて見えてきた、AI時代の組織に必要な3つの原則を整理します。抽象的な話に見えるかもしれませんが、どれも実装可能な考え方です。そしてこの3つは、AIが関わらない普通の組織運営にも通用するものだと感じています。

この記事の結論

- 原則1: 取り返し境界の設計:業務を「取り返しがつく/つかない」に最初に分類し、別の管理レイヤーで扱う。迷ったら取り返しがつかない側に寄せる

- 原則2: 物理で守る権限:ルールで「やっちゃダメ」と言うのではなく、構造として「やろうとしてもできない」状態を作る。AIは人間の数倍速で暴走し得るため制度単独では守れない

- 原則3: 反対意見の構造的採用:空気を読む意思決定を防ぐため、悪魔の代弁者(Devil's Advocate)をロールとして制度化。AIにも複数の立場を明示的に演じさせる

- 3原則の本質:AI固有の話ではなく、普通の組織運営で通用する原則をAIが厳密に要求するだけ。「AIを使いこなす組織はAIがいなくても強い」

- 適用場面:AI導入を検討している中小企業、AIエージェント運用で事故を防ぎたい現場、AI活用の組織設計を担う経営・ガバナンス層

原則1: 「取り返しがつくもの」と「取り返しがつかないもの」を、最初に分ける

組織設計で一番最初にやるべきは、業務を「取り返しがつくもの」と「取り返しがつかないもの」に分類することだと思っています。

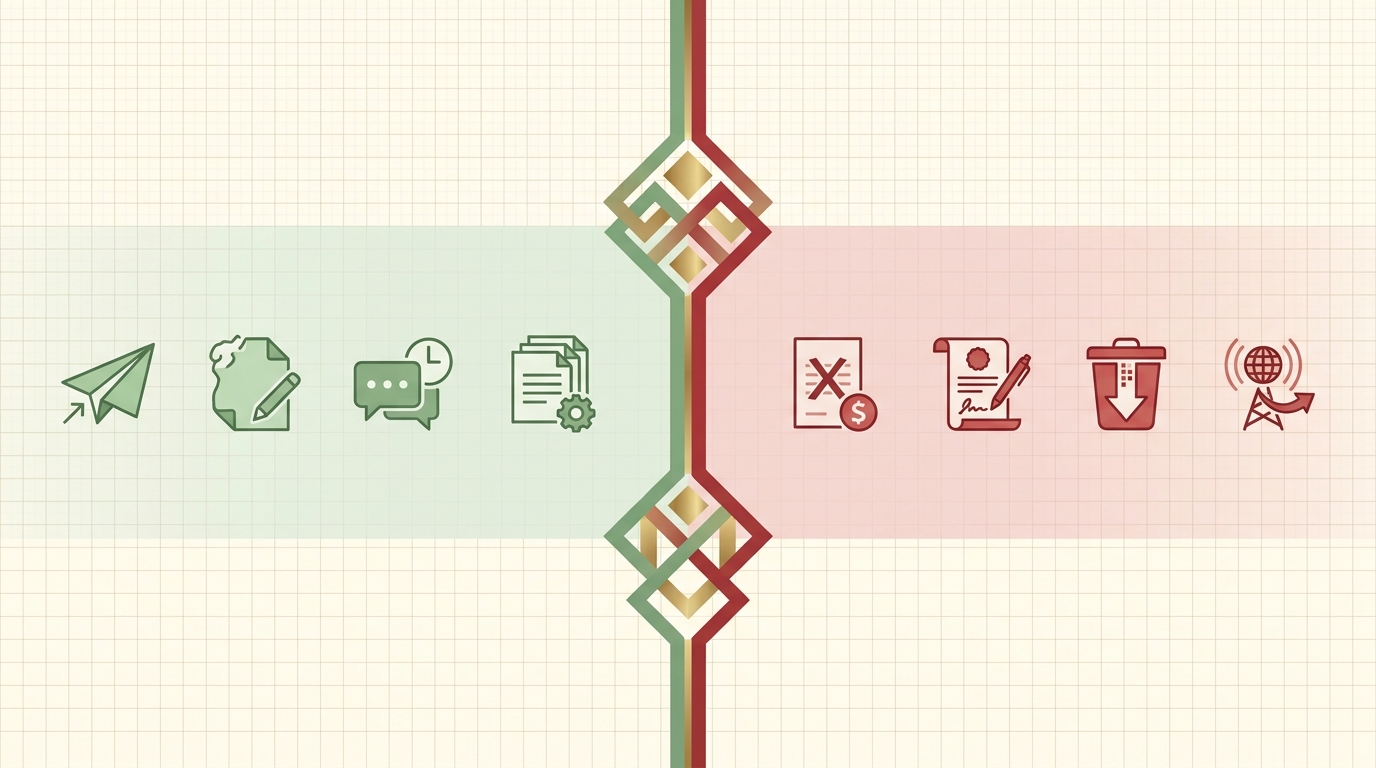

取り返しがつく業務とは、失敗しても元に戻せる業務です。メールの下書き、資料の草案、議事録の要約、社内向けのレポート作成。これらは間違っても、書き直せばいい。リスクは時間の無駄くらい。

一方、取り返しがつかない業務とは、一度実行したら戻せない業務です。顧客への請求処理、契約書の送付、データベースの構造変更、外部への情報発信。これらは間違えたら、取り消すのに多大なコストがかかる、あるいは取り消すこと自体が不可能です。

この2つを分けずに扱うのが、組織のトラブルの温床になります。

なぜ分けないとまずいのか

分けない組織では、「便利だから」という理由で、取り返しがつかない業務までAIに任せ始めます。最初はうまくいくんです。でも、判断が微妙な境界事例が必ず出てきます。そのとき、取り返しがつかない業務で一度でも判断を間違えると、ダメージが組織全体に波及する。

人間の従業員でも同じで、新人にいきなり「顧客への請求処理」を任せる会社はないはずです。まず社内業務から始めて、取り返しがつく範囲で経験を積ませてから、徐々に責任の重い業務に昇格させる。これは長年かけて組織が学んできた知恵です。

AI活用でも、同じ階段設計が必要です。取り返しがつく業務と取り返しがつかない業務は、別の管理レイヤーで扱う。具体的には、取り返しがつかない業務には「人間の承認」「実行前のドライラン(試運転)」「事後の検証プロセス」のような余分なステップを挟む。

境界を曖昧にしない

この原則で一番難しいのは、「取り返しがつく」と「取り返しがつかない」の境界線をどこに引くかです。

現場の人間は、たいてい境界を緩く引きたがります。「これくらいなら大丈夫」「めったに失敗しない」。気持ちは分かるんですが、境界を緩く引くほど、いざというときのダメージが大きくなる。

私が実装するときのルールは、「迷ったら、取り返しがつかない側に分類する」。これで多少、管理コストは増えます。でも、組織全体の安全性はこちらのほうが圧倒的に高い。取り返しがつくと判断した業務が実はそうでなかったときのダメージと比べれば、安いコストです。

原則2: 権限は、制度ではなく物理で守る

これが、今回一番お伝えしたい原則です。

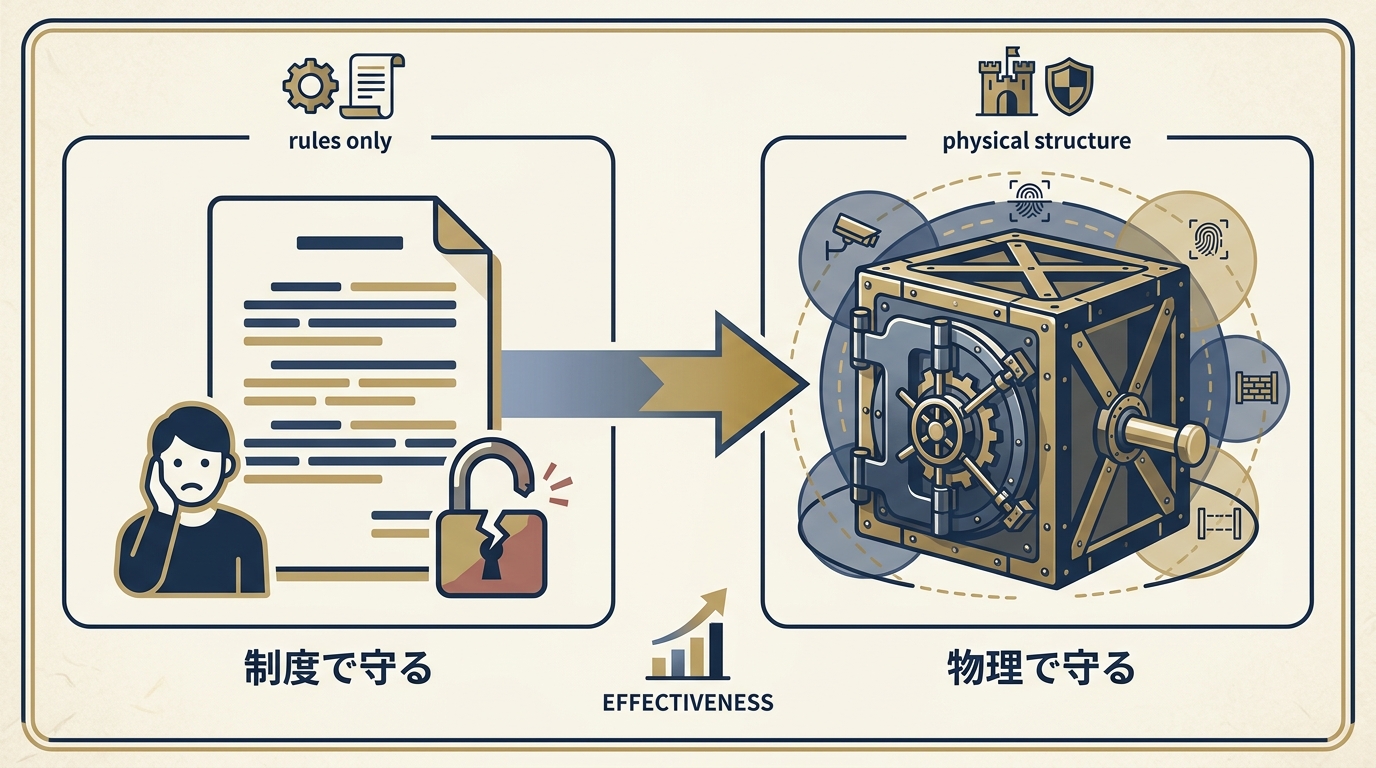

組織運営における権限管理は、多くの場合「制度」で実装されています。役職、決裁規程、承認フロー。「部長以上のみ、この金額以上の決裁ができる」「社外秘情報の持ち出しは禁止」。ルールとして定めて、違反したら叱る、という構造です。

でも、制度だけで守れる権限は、実は限られているんです。

制度で守る限界

例えば、うっかりミスでルール違反が起きることは、どの組織でも経験があるはず。「このファイル、外部に送っちゃダメなやつだったけど、うっかり添付して送った」「この金額、本当は社長承認が必要だったけど、気づかず処理した」。

これらは、制度だけでは防げません。人間の注意力には限界があって、制度を知っていても違反は起きるからです。

AI時代の組織では、この問題がさらに深刻になります。AIは人間の数倍のスピードで業務を処理するので、もし権限を誤って付与してしまうと、人間が気づく前に大量の違反行動が起きる可能性がある。「やっちゃいけないことを、気づいたら100件やっていた」という事態が、物理的に起こりうる。

物理で守るとは

ここで必要なのが、「制度で守る」から「物理で守る」への発想転換です。

物理で守るとは、ルールを破ろうとしても、そもそもできない構造にしておくこと。

分かりやすいアナロジーは、銀行の金庫です。銀行員全員に「金庫に入っちゃダメ」と制度で言うのではなく、金庫の鍵を特定の人しか持てないようにする。鍵を持っていない人は、ルールを守る守らない以前に、物理的に金庫に入れない。

AI組織でこれを実装するなら、例えばこういう形になります。

- 最も危険な操作(本番データの全削除、課金処理の実行など)を行う権限を、AIの手の届かない場所に置く

- AIがいくら暴走しても、その権限にアクセスできない構造にする

- その権限を使うときは、人間が明示的に別の場所から取ってくる必要がある

こうすると、AIが誤って(あるいは悪意ある入力によって)危険な操作を試みても、そもそも実行できない。制度で「やっちゃダメ」と言うのではなく、やろうとしてもできない状態にしておく。

人間組織にも通用する

この「物理で守る」発想は、AIに限らず組織運営全般に通用します。

例えば、経理の不正を防ぎたいとき、「ルール違反はダメ」という教育だけでは限界があります。それよりも、「一人で決裁できる金額の上限を物理的に設定する」「システムで二重承認を強制する」という構造を作るほうが効く。

多くの中小企業で経理不正が起きるのは、担当者が悪人だからではなく、一人の人間の判断に依存する構造があるからです。構造を変えれば、善悪の議論をせずに不正は減ります。

AI時代の組織設計は、この「構造で守る」発想をさらに徹底する必要があります。制度(ルール)と物理(構造)の両輪で権限を管理する。どちらが欠けても、組織は守れません。

原則3: 反対意見を、構造的に採用する仕組みを作る

3つ目は、意思決定プロセスの話です。

組織の意思決定で最もよく起きる失敗は、「全員が同じ方向を向いて合意した結果、間違った方向に進む」ことだと思っています。反対意見が出ない会議、提案がそのまま通る稟議。こうした「空気の良い」意思決定が、大きな失敗の温床になります。

反対意見は、放っておくと消える

なぜ反対意見が出ないのかというと、人間は基本的に場の空気を読む生き物だからです。特に経営者や上司が熱を込めて提案した案に、正面から反対意見を述べるのは心理的に難しい。「水を差したくない」「流れを止めたくない」という遠慮が、反対意見を封じ込めます。

結果として、組織はイエスマンで固まった意思決定を繰り返します。表面的には順調に見えても、実は重要な懸念が議論されないまま進行している。気づいたときには、引き返せない地点まで来ている。

これは人間だけの問題ではなく、AIとの対話でも全く同じ構造で起きます。AIは基本的に、ユーザーの意向に沿った回答を生成する傾向がある。「この企画どう思う?」と聞けば、良い点を並べてくれる。反対意見は、明示的に求めない限り出てきません。

反対意見を「演じさせる」プロセス

私がAIを使って意思決定するときの工夫の一つが、複数の立場を明示的に演じさせることです。

例えば新しい施策を検討するとき、AIに「この施策の賛成側の論拠」「懐疑側の論拠」「実行担当者の視点」「顧客の視点」を、それぞれ別の立場として書かせる。そして、必ず一人は悪魔の代弁者(Devil's Advocate)として、計画そのものを根本から疑わせる。

これをやると、自分一人で考えていたら絶対に出てこなかった懸念が、次々と浮かび上がります。「そもそも、これをやる必要があるんでしたっけ?」「この問題は、実はもっと単純な方法で解決できませんか?」。普段なら場の空気で封印される問いが、プロセス上必ず出てくる設計にできる。

そして重要なのが、出てきた反対意見を単に聞いて終わらせず、採用候補としてリストに載せること。「これは反対意見ですが、却下します」「これは反対意見ですが、一部採用します」と明示的に判断する。反対意見を放置するのと、却下すると決めるのは、全く違う行為です。

人間の会議にも組み込める

このプロセスは、人間だけの会議にも組み込めます。

会議のたびに、メンバーの中から一人を悪魔の代弁者役として指名する。その人は、会議中は提案に反対する立場で発言する義務を負う。本心がどうであれ、反対派として振る舞う。

これを制度化すると、反対意見が役割として存在する状態になります。「個人的に反対したくて反対している」のではなく、「今日は役割として反対している」。これだと、空気を壊す罪悪感なく反対意見を言えるし、聞く側も個人攻撃として受け取らずに済む。

多くの組織で反対意見が出ないのは、人が悪いからではなく、反対意見を言う役割が設計されていないからなんですよね。

AIを使いこなす組織は、AIがいなくても強い

3つの原則を並べてきましたが、気づいた方もいるかもしれません。これらは全部、AI抜きでも通用する組織原則です。

取り返しがつくものと取り返しがつかないものを分けるのは、どんな業務設計でも基本です。権限を物理で守るのは、古典的なセキュリティ原則そのもの。反対意見の構造的採用は、組織論の古典です。

では、なぜAI時代にこの原則を改めて強調するのかというと、AIはこれらの原則の甘さを露呈させる増幅器だからです。

判断の境界が曖昧な組織は、AIを使うと境界違反が大量発生する。権限が制度だけで守られている組織は、AIを使うとその脆弱性が一気に露見する。反対意見が出ない組織は、AIを使うと「全員賛成」のスピードが上がって、失敗も加速する。

つまり、AI時代の組織設計は、AIのための特殊な話ではなく、普通の組織運営の原則を厳密に適用する話だと思っています。だからこそ、「AIを使いこなす組織は、AIがいなくても強い」。逆に、「AIがいないと回らない組織」は、実はAIが来ても回らないんですよね。

組織の基盤を作るのは、結局、人間の設計思想です。ツールがどれだけ進化しても、この部分だけは自動化できません。そしてこの部分こそが、AI時代に差をつけるポイントになると感じています。

何か新しいツールを導入する前に、自社の組織が3つの原則に沿って設計されているか、一度立ち止まって確認してみる。地味ですが、これが一番効く投資だと思います。

関連記事

この記事のテーマに合うサービス:AIエージェント活用設計

AIエージェントを「使える形」まで設計する